Grønne datasentre

Cloud Computing baserer seg på bruk av tilgjengelige kapasiteter på Internett, og det vil si diskplass, prosessorkraft og direkteminne i de største tilgjengelige datasentre verden rundt. Datasentre har hatt en stabil vekst i kapasitet, også strømforbruk, som igjen omsettes til “greenhouse gases”, eller klimagasser.

Cloud Computing baserer seg på bruk av tilgjengelige kapasiteter på Internett, og det vil si diskplass, prosessorkraft og direkteminne i de største tilgjengelige datasentre verden rundt. Datasentre har hatt en stabil vekst i kapasitet, også strømforbruk, som igjen omsettes til “greenhouse gases”, eller klimagasser.

Vi har sett en dobling i energiforbruket til dataprosessering, og et datasenter kan bruke like mye energi som 25.000 husstander… Årlig CO2-utslipp fra verdens datasentre vil øke fra 80 til 340 megatonn innen 2020. U.S. EPA estimerer en dramatisk vekst i energiforbruk ved datasentre (USA): 61 mrd kW i 2006, til 100 mrd kW i 2011.

Cloud Computing baserer seg på bruk av tilgjengelige kapasiteter på Internett, og det vil si diskplass, prosessorkraft og direkteminne i de største tilgjengelige datasentre verden rundt.

Cloud Computing baserer seg på bruk av tilgjengelige kapasiteter på Internett, og det vil si diskplass, prosessorkraft og direkteminne i de største tilgjengelige datasentre verden rundt.

Datasentre har hatt en stabil vekst i kapasitet, og med kapasitetsøkning følger også økning i strømforbruk, som igjen omsettes til såkalte “greenhouse gases”, eller klimagasser. På de seks årene mellom 2000 og 2006 doblet energimengden benyttet til dataprosessering og datalagring, og et gjennomsnittlig datasenter brukte ved periodeutløpet like mye energi som 25.000 husstander… Samlet kommer det årlige CO2-utslipp fra verdens datasentre til å øke fra 80 metriske megatonn i 2007 til 340 metriske megatonn i 2020. Dette er tall fra en analyserapport utarbeidet av McKinsey & Company i samarbeid med The Uptime Institute. U.S. Environmental Protection Agency (EPA) estimerer en dramatisk vekst i energiforbruk ved amerikanske datasentre: 61 mrd kW i 2006, som vil øke til 100 mrd kW i 2011.

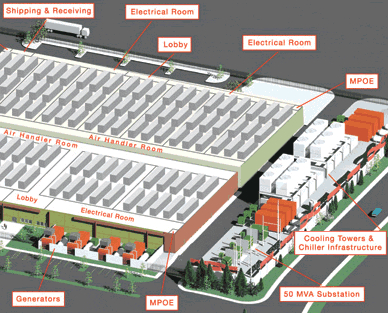

For 10 år siden forbrukte et server-rack omtrent 2 kilowatt, mens en fullt konfigurert blade-server som erstatter denne i dag forbruker kanskje så mye som 25 kilowatt… Prioriteringene endrer seg: mens man før kvantifiserte et datasenter i kvadratmeter, kvantifiserer man det i dag etter tilgjengelig kraft og kjøling.

Den tradisjonelle strategien for bygging av datasentre har tidligere vært fokusert på å kunne oppnå maksimal oppetid, mens det var liten eller ingen fokus på energisparing eller miljøbevisst design. Kun i det siste tiår har datasenterdesignere og –konstruktører begynt å innse at en høy up-front investering i datasentre blir kompensert av lavere drifts- og vedlikeholdskostnader på lang sikt.

Telecommunications Industry Association, internasjonal TIA-942 Data Center Standards

|

Tier level |

Tekniske krav |

|

1 Basic |

|

|

2 Redundant components |

|

|

Concurrently maintainable |

|

|

Fault tolerant |

|

De datasentrene Administrator Systems har valgt å syndikere for våre kunder, er blant verdens største og av høyeste standard, tier 4, og disse er designet for å kunne yte 99,99% tilgjengelighet, også kalt oppetid. Men vi setter også som en klar betingelse at våre underleverandører kan tilby miljøvennlige datasentre.

De datasentrene Administrator Systems har valgt å syndikere for våre kunder, er blant verdens største og av høyeste standard, tier 4, og disse er designet for å kunne yte 99,99% tilgjengelighet, også kalt oppetid. Men vi setter også som en klar betingelse at våre underleverandører kan tilby miljøvennlige datasentre.

Samtidig utvikler verdens land nye regulatoriske krav til dets innbyggere, også innen felt som strengt berører IT-bransjen, med et viktig hovedmål å begrense belastningen IT-utstyr over hele livssyklusen (produksjon, drift, destruksjon) legger på miljøet rundt oss: EU Restriction of Harardous Substances (RoHS), EU Waste Electrical and Electronic Equipment (WEEE), Energy-using Products (EuP) direktivet regulerer eco-design av energiforbrukende produkter, LEED green building-graderingssystem, osv. Eksempelvis ga USAs kongress i desember 2006 Environmental Protection Agency (EPA) klarsignal til å gjennomføre gjennom sitt Energy Star-program:

-

Evaulere veksten i datasenter-strømforbruk i både føderal og privat sektor

-

Evaluere status på mer energieffektive datamaskiner og –utstyr

-

Analysere kostnadsbesparelser og tilhørende fordeler som kan oppnås ved mer aggressive konserveringsmetoder

-

Anbefale videre incentiver regjeringen kan gi for å øke energibesparelser i datasentre

Dette vedtaket førte til et viktig skifte i den hvordan datasentre fungerer – ikke bare i USA, men også i Europa og resten av verden.

Samtidig fører teknologisk utvikling til at strømforbruket og varmeutviklingen til de mest høytytende servere stadig strekkes, og har etterhvert blitt en betydelig økonomisk kostnad (energiforbruk til både CPU-sykluser og til kjøling av varme).

Samtidig fører teknologisk utvikling til at strømforbruket og varmeutviklingen til de mest høytytende servere stadig strekkes, og har etterhvert blitt en betydelig økonomisk kostnad (energiforbruk til både CPU-sykluser og til kjøling av varme).

I dag er strømforbruket for å drifte en server normalt høyere enn selve hardwaren – typisk vil en servers energikost passere hardware-investeringskost innen 2 år, og differansen krymper stadig!

Dette viser at man har både regulatoriske og økonomiske motiv for å bli et miljøvennlig datasenter, og både regulatoriske, økonomiske og praktiske hensyn gjør at datasentre ofte samles i grupper, som bildet til venstre tydelig illustrerer.

Viktige mål for nybygg av moderne datasentre i dag er:

-

Redusert energiforbruk

-

Fornybare ressurser

-

Etterrettelighet

-

Forsvarlige livssykluser

Virtualisering av servere forbedrer utnyttelse av hardware (og dermed strømforbruk) – En server av den tradisjonelle arkitekturen er designet og utstyrt for å klare de høyeste belastningen brukermassen krever, men det praktiske problemet er at belastningen varierer og fordeler seg ulikt over et arbeidsdøgn – de høyeste belastningene samler seg i tydelige “topper” gjennom døgnet. Derfor må man tradisjonelt dimensjonere den enkelte server for toppene, og serveren vil derfor statistisk kun være utnyttet ca 15% på et tilfeldig tidspunkt… Virtualisering gjør at man kan implementere mange server-instanser på samme (men mye større) server hardware, og jo flere servere og brukermiljøer, jo jevnere fordeling av belastning får man utover døgnet. Dermed kan man klare en langt høyere utnyttelsesgrad, og langt lavere produkjsonsforbruk og strømforbruk pr server, ved virtualisering enn ved enkeltvis en-server-per-hardware.

Peer-to-Peer (P2P) er en arkitektur som kan vurderes som et alternativ til clustring i store datasentre. Når man clustrer tusenvis av servere i et lukket rom, utvikles mye varme, og dette krever energiforbrukende kjølesystemer for å nå en lav/operativ temperatur. Imidlertid viser forskningsrapporter, som bl.a. “Hot Data Centers vs. Cool Peers” fra industri/universitets-forskningssamarbeidet Intel Labs Berkeley, USA, at et spredt P2P-nettverk krever omfattende routing (nettverk + routere + endesystemer), som også vil konsumere betydelig energi og avgi varme, totalt. Eksakte kalkulasjoner basert på normerte faktorverdier viser at datasenter gir den beste ytelse pr forbrukt energi – husk: vi regner her den samlede globale kostnaden av databehandling på de to ulike arkitekturer, ikke pr strømkunde. Berkleys analyse avslutter med å peke på viktigheten av en overordnet systemarkitektur (en total plan) for å bestemme energieffektiviteten i en nettverkstjeneste, og ikke konkludere på en enkelt del.

Foretrukket plassering av datasentre har endret seg med kravene: med hensyn til ovenfornevnte mål (punktlisten), er det i dag fordelaktig å plassere store datasentre på landet, godt utenfor byenes høye tomtepriser, og nærmest mulig de naturressursene som behøves for kraftproduksjon og kjøling.

En stor del av verdens største datasentre i dag er lokalisert i USA, og de siste årene har de bevisst tenkt miljø. Flere datasentre er i dag drevet av sol- og vindkraft (solcellepaneler, vindmøller), kjølt av geotermiske- og vindsystemer, etc – og flere velger også å samarbeide med U.S. Green Building Council(USGBC) og Co-Op America, det amerikanske Environmental Protection Agency (EPA) for retningslinjer og deling av erfaring. Green Power Partnership er en …. Intel forbruker årlig 1,3 milliard KWh, og kjøper pr i dag 46% av sitt forbruk fra vindkraft. Ved sitt anlegg i Foster City, California, kjøper IBM inn 100% av sitt kraftbehov fra fornybare ressurser, og det samme gjør AMD ved sit senter i Austin, Texas, USA. USGBC LEED er et internasjonalt anerkjent “green building” sertifiseringssystem, og vurderer en rekke kriterier ved en bygning: energi, atmosfære, materiale og ressurser, innendørsmiljø, bærekraftighet, vanneffektivitet, lokasjon og kommunikasjonsforbindelser, brukers innsikt og miljøutdanning, designinnovasjon og regional samfunnsprioritet.

En stor del av verdens største datasentre i dag er lokalisert i USA, og de siste årene har de bevisst tenkt miljø. Flere datasentre er i dag drevet av sol- og vindkraft (solcellepaneler, vindmøller), kjølt av geotermiske- og vindsystemer, etc – og flere velger også å samarbeide med U.S. Green Building Council(USGBC) og Co-Op America, det amerikanske Environmental Protection Agency (EPA) for retningslinjer og deling av erfaring. Green Power Partnership er en …. Intel forbruker årlig 1,3 milliard KWh, og kjøper pr i dag 46% av sitt forbruk fra vindkraft. Ved sitt anlegg i Foster City, California, kjøper IBM inn 100% av sitt kraftbehov fra fornybare ressurser, og det samme gjør AMD ved sit senter i Austin, Texas, USA. USGBC LEED er et internasjonalt anerkjent “green building” sertifiseringssystem, og vurderer en rekke kriterier ved en bygning: energi, atmosfære, materiale og ressurser, innendørsmiljø, bærekraftighet, vanneffektivitet, lokasjon og kommunikasjonsforbindelser, brukers innsikt og miljøutdanning, designinnovasjon og regional samfunnsprioritet.

LEED Gold og LEED Platinum er to av de høyeste utmerkelsene en særlig miljøvennlig bygning kan få, og er en status som flere og flere fremsynte datasenter-eiere streber etter, både av direkte miljøhensyn – og indirekte økonomiske hensyn. EPA har siden 2006 en egen Energy Star-rangeringssystem for datasentre, og kun de som rangerer blant topp 25% av de innrapporterte datasentrene kan få denne eco-utmerkelsen. Green Grider et globalt konsortium som dedikerer seg til å videreutvikle og forbedre energieffektivitet for verdens datasentre.

LEED Gold og LEED Platinum er to av de høyeste utmerkelsene en særlig miljøvennlig bygning kan få, og er en status som flere og flere fremsynte datasenter-eiere streber etter, både av direkte miljøhensyn – og indirekte økonomiske hensyn. EPA har siden 2006 en egen Energy Star-rangeringssystem for datasentre, og kun de som rangerer blant topp 25% av de innrapporterte datasentrene kan få denne eco-utmerkelsen. Green Grider et globalt konsortium som dedikerer seg til å videreutvikle og forbedre energieffektivitet for verdens datasentre.

Flere av de største datasentrene velger også å dedikere egne stillinger, Chief Environmental Officers, til å overvåke og påse at implementasjon og drift følger de retningslinjer som er anbefalt eller påkrevet, og måle suksess – men også å gjøre undersøkende virksomhet i siste utvikling innen miljøspørsmål, -effektivitet og -teknologi. Samtidig vil disse påse at datautstyr får en forsvarlig livssyklus, bl.a. at utdatert utstyr utfases, og ødelagt utstyr destrueres eller resirkuleres på en ren og miljøvennlig måte.

Man kjenner Stockholmsom et av verdens største ITK-områder, med over 20.000 IKT-bedrifter og 95.000 IKT-arbeidsplasser. Området er hjemsted til kjente innovatorer som Ericsson (SonyEricsson) og Telia (TeliaSonera), og at verdens første 4G-nett ble satt i drift her, er også illustrerende. Stockholm har vært proaktive, og i Stockholmsområdet ser man et stadig økende antall datasentre, en vekst oppnådd ved bevisst promotering ved idéen om “grønne” datasentre. Stockholm hevdes å tilby en nær perfekt lokasjon for datasentre, da miljøavtrykket vil være nær null. For eksempel kan klimaet tilby tilstrekkelig luftkjøling året rundt – ingen aircondition er påkrevet for å holde datasentrene kjølige. Dette gir svært kosteffektiv drift. (…dette hadde vært en idé for Norge, med en enda mer idéelle klima- og natuforhold for kraft og kjøling!). To viktige kriterier for valg av lokasjon til nye datasenter er, ifølge Martijn Loderus, Sun Microsystems (bekrefter generelle mål listet tidligere):

Man kjenner Stockholmsom et av verdens største ITK-områder, med over 20.000 IKT-bedrifter og 95.000 IKT-arbeidsplasser. Området er hjemsted til kjente innovatorer som Ericsson (SonyEricsson) og Telia (TeliaSonera), og at verdens første 4G-nett ble satt i drift her, er også illustrerende. Stockholm har vært proaktive, og i Stockholmsområdet ser man et stadig økende antall datasentre, en vekst oppnådd ved bevisst promotering ved idéen om “grønne” datasentre. Stockholm hevdes å tilby en nær perfekt lokasjon for datasentre, da miljøavtrykket vil være nær null. For eksempel kan klimaet tilby tilstrekkelig luftkjøling året rundt – ingen aircondition er påkrevet for å holde datasentrene kjølige. Dette gir svært kosteffektiv drift. (…dette hadde vært en idé for Norge, med en enda mer idéelle klima- og natuforhold for kraft og kjøling!). To viktige kriterier for valg av lokasjon til nye datasenter er, ifølge Martijn Loderus, Sun Microsystems (bekrefter generelle mål listet tidligere):

-

Lett tilgang til naturressurser for kraft og kjøling

-

Lokal bemanning for bygging, drift og vedlikehold

Et norsk bidrag er Opera Software, med hovedkontor i Norge, som i mai 2010 ble første kunde hos Thor Data Centeri Hafnarfjordur, tredje største by i Island. Opera flytter en betydelig del av kundetrafikk til sin installasjon ved dette senteret. Thor drives av kun fornybar energi, og kan med dette håndtere 78 Petabytes data (tilsvarende ca 1 trillion Facebook-sider). At datasenteret driftes 100% av fornybar energi, samt at Island har en av de mest stabile krafttilgangene (og kraftpriser) nå og i fremtiden, er hovedgrunn til at Opera valgte å flytte driften til Island. Den vulkanske aktiviteten gir uendelige mengder geotermisk kraft, og den geografiske posisjonen midt mellom Nord-Amerika og Europa gir en idéell fordeling av trafikk. Klimaet er også idéelt for luftkjølte datasentre, med gjennomsnittlig temperatur i januar på -0,5° C og +10,3° C i juli. Datasenteret er LEED Gold-sertifisert.

Thor Data Center i Hafnarfjordur er bygget på det nye “Data Containers”-prinsippet. Detter er enkelt fortalt vanlige 20- eller 40-fots land/sjø cargo-containere, installert pre-wired med racks, servere, UPS-strømforsyninger, brannslukking/sikring og kjøleanlegg – Thor sparer seg for aircondition-installasjon/forbruk, og trekker i stedet utendørs luft rett gjennom containerne for kjøling. På bildet til høyre sees to 40-fots datacontainere inne i Thor D.C, og man kan anta at øvre container er for strømkonvertering og UPS, og at nedre er for servere da den har personaldør for tilgang i tilfelle vedlikehold.

Thor Data Center i Hafnarfjordur er bygget på det nye “Data Containers”-prinsippet. Detter er enkelt fortalt vanlige 20- eller 40-fots land/sjø cargo-containere, installert pre-wired med racks, servere, UPS-strømforsyninger, brannslukking/sikring og kjøleanlegg – Thor sparer seg for aircondition-installasjon/forbruk, og trekker i stedet utendørs luft rett gjennom containerne for kjøling. På bildet til høyre sees to 40-fots datacontainere inne i Thor D.C, og man kan anta at øvre container er for strømkonvertering og UPS, og at nedre er for servere da den har personaldør for tilgang i tilfelle vedlikehold.

Mens Thor bruker leverandøren AST i Spania, var det Sun Microsystems som ble den første store leverandøren av data containers, med deres BlackBox datacenter-system i 2006. Data container-prinsippet muliggjør rask utrulling og fleksibilitet i skalering for å tilpasses kundenes etterspørsel. En 40-fots container kan huse hardware for opptil 2000 servere. Data containerne er plassert i enorme racks, vanligvis 1-2 i høyden, inne i datasenterets bygning, og kan lett byttes ut ved hjelp av traverskraner montert i datasenterets tak, truck-kran og semitrailer.

Mens Thor bruker leverandøren AST i Spania, var det Sun Microsystems som ble den første store leverandøren av data containers, med deres BlackBox datacenter-system i 2006. Data container-prinsippet muliggjør rask utrulling og fleksibilitet i skalering for å tilpasses kundenes etterspørsel. En 40-fots container kan huse hardware for opptil 2000 servere. Data containerne er plassert i enorme racks, vanligvis 1-2 i høyden, inne i datasenterets bygning, og kan lett byttes ut ved hjelp av traverskraner montert i datasenterets tak, truck-kran og semitrailer.

Yahoo åpnet nylig (oktober 2010) et nytt energi-effektivt datasenter i Lockport, staten New York, USA, og de håper at dette vil være et av verdens mest energi- og kosteffektive datasenter. Datasenteret er det første til å benytte Yahoo Computing Coop (YCC), også kalt “Yahoo Chicken Coop”, det mest avanserte grønne datasenter-designet i sin klasse, anerkjent av U.S. Dept. Of Energy med en subsidiering på 9,9 million USD. Også dette anlegget bruker utvendørs luft til kjøling, og får energiforbruket for kjøling ned til å være kun 1% av det totale energiforbruket i senteret. Datasenteret har en strømforbrukseffektivitet på 1,08, mens industrien i gjennomsnitt har en dårligere effektivitet med sine 1,922. Dette første YCC-datasenteret forbruker 40% mindre strøm og 95% mindre vann enn gjennomsnittet for datasentre i USA. Besparelsene gir til overs strøm for 9.000 husstander, eller strøm nok til 1,1 millioner notebook-PCer i et helt år… Energisparingen vil økonomisk sett gi Yahoo! et forretningsfortrinn. Dessuten gir øko-tenkingen seg utslag i samfunnsnytten ved mange nye arbeidsplasser i et område med høy arbeidsledighet, som Lockport er (ref. kriterier for LEEF Gold).

Yahoo åpnet nylig (oktober 2010) et nytt energi-effektivt datasenter i Lockport, staten New York, USA, og de håper at dette vil være et av verdens mest energi- og kosteffektive datasenter. Datasenteret er det første til å benytte Yahoo Computing Coop (YCC), også kalt “Yahoo Chicken Coop”, det mest avanserte grønne datasenter-designet i sin klasse, anerkjent av U.S. Dept. Of Energy med en subsidiering på 9,9 million USD. Også dette anlegget bruker utvendørs luft til kjøling, og får energiforbruket for kjøling ned til å være kun 1% av det totale energiforbruket i senteret. Datasenteret har en strømforbrukseffektivitet på 1,08, mens industrien i gjennomsnitt har en dårligere effektivitet med sine 1,922. Dette første YCC-datasenteret forbruker 40% mindre strøm og 95% mindre vann enn gjennomsnittet for datasentre i USA. Besparelsene gir til overs strøm for 9.000 husstander, eller strøm nok til 1,1 millioner notebook-PCer i et helt år… Energisparingen vil økonomisk sett gi Yahoo! et forretningsfortrinn. Dessuten gir øko-tenkingen seg utslag i samfunnsnytten ved mange nye arbeidsplasser i et område med høy arbeidsledighet, som Lockport er (ref. kriterier for LEEF Gold).

Emerson data center i Missouri, Tennessee, USA, bruker også fornybar energi, i form av solenergi. De har 550 egne solcellepaneler, som kan generere 100 kilowatt. Også av miljøhensyn ble 80% av konstruksjonsavfallet resirkulert. Fasiliteten vil få tildelt LEED Gold fra USGBC.

Og hva vil fremtiden kunne bringe? Det er klar fokus på den største utfordringen: energiforbruk. Autoriteter innen fagområdene server-virtualisering og datasenter ser allerede i dag at det ikke er tilstrekkelig for datasenter-administrasjonen å kun overvåke strømforbruk pr hardwareenhet. Mens man i dag har fokus på den fysiske infrastrukturen, atenergi blir forbrukt og hvor mye, vil man i framtiden ha behov for å forstå hvorforenergi blir forbrukt, og av hvem. De blir tvunget til å kartlegge sammenhengen mellom en forretningsvirksomhet, IT-operasjoner, og energiforbruket.

Og hva vil fremtiden kunne bringe? Det er klar fokus på den største utfordringen: energiforbruk. Autoriteter innen fagområdene server-virtualisering og datasenter ser allerede i dag at det ikke er tilstrekkelig for datasenter-administrasjonen å kun overvåke strømforbruk pr hardwareenhet. Mens man i dag har fokus på den fysiske infrastrukturen, atenergi blir forbrukt og hvor mye, vil man i framtiden ha behov for å forstå hvorforenergi blir forbrukt, og av hvem. De blir tvunget til å kartlegge sammenhengen mellom en forretningsvirksomhet, IT-operasjoner, og energiforbruket.

Et par eksempel som illustrerer at denne tankegangen begynner å få feste, er at datasenter-industrien har tatt i bruk nye målebegrep for kvantifisering:

-

Et sentralt begrep er Power Usage Effectiveness (PUE), som er forholdet mellom Total fasilitets-energiforbruk dividert på IT-utstyrs forbruk. PUE 2.0er gjennomsnittet for industrien frem til ca år 2009, mens PUE 1,2er svært effektivt i dag. Den positive utviklingen antyder at dette nivået kan bli norm de nærmeste årene.

-

De Japanske myndigheter går ett skritt videre, og har foreslått en ny måleenhet for energiutnyttelse i datasentre, Data Center Bits Per Energy (DCBPE), som enkelt fortalt er forholdet mellom Totalt antall bits per sekund (bps) dividert på strømforbruket for denne prosesseringen.

Siden hele datasenteret er på vei mot å bli en virtuell infrastruktur, hvor applikasjonsmobilitet ikke bare er en perifér løsning, men selve kjernen av datasenter-operations, kan ikke løsningene angripe problemet med energiforbruk fra fysisk infrastruktur-perspektivet, med enhetsmonitoring og sensorer – løsningene må komme fra den andre retningen: applikasjonssiden. Og metodene for måling og analyse må utvikles til å bli langt mer raffinerte enn dagens nivå. Bare da vil forretninger klare å etablere strategier og operasjoner for å drive mer effektivt, høyt optimaliserte og virkelig øko-vennlige datasentre. Men tallene viser at bare de siste få årene har bransjen kommet et godt stykke på vei.

Et absolutt styrende målebegrep for fremtidens datasentre er karbon-avtrykket, engelsk: carbon footprint. Karbon-avtrykket er et målebegrep på den totale mengde karbondioksid (CO2) og andre klimagasser, som f.eks metan, ozon, klorofluorkarboner, m.m., som er skapt av livssyklusen til et produkt eller tjeneste, og dette blir brukt som en måleenhet for den totale påkjenning en person eller organisasjon har på miljøet. Dette vil, og er allerede i ferd med, å forandre utformingen av datasentre radikalt – vi kan forvente mye nytt!

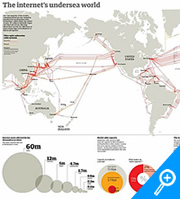

Før vi avrunder, og for helhetens del, tar vi med litt om «alt det i mellom» – transportkanalene, eller nettverket. Det er ikke satellitter som knytter routere og datasentrene sammen, men god «gammeldags» kabelteknologi – vel og merke optisk fiber, i all hovedsak.

Før vi avrunder, og for helhetens del, tar vi med litt om «alt det i mellom» – transportkanalene, eller nettverket. Det er ikke satellitter som knytter routere og datasentrene sammen, men god «gammeldags» kabelteknologi – vel og merke optisk fiber, i all hovedsak.

På kartet ser du en oversikt over hvordan verdens Internett-datasentre er knyttet sammen mellom land og konentene med kabler av ulik teknologi, kapasitet og redundans. F.eks, en trans-Atlantisk kapasitet på 7 trillion bps høres slett ikke verst ut…

Klikk på kartet til venstre for å få et større bilde av kartet, i eget browservindu. Kartet er hentet fra The Guardian, UK, og er utarbeidet av TeleGeography.com. For flere kart (følgende 3: globale Internett-nettverk, globale sjøkabel-nettverk og globale telefoni-nettverk, se egen side for Globale nettverkskart).

Helt på tampen – for at du skal få litt mer innblikk, vil vi til slutt invitere deg med på en guidet tur gjennom et av de omtalte tier 4-datasentrene, av den nyere data container-typen, som også har gjort noen av de nevnte “best practice” eco-tiltakene. Se følgende video fra et Google-datasenter– dette er filmet i et datasenter av de mindre klassene for data containers Google har, og ble bygget i 2005 (videoens varighet: 6 min 37 sek):

[embedyt] https://www.youtube.com/watch?v=zRwPSFpLX8I[/embedyt]

For en mer inngående presentasjon av en slik “efficient data centers”-strategi, se følgende video fra et seminar for Googles egne datasenter-fagfolk under «Google Efficient Data Centers Summit» i april 2009, hvor de bl.a. gjennomgår hvordan de ved å strengt følge sin “best practices” nådde en PUE på kun 1,16 (1. av 3 videoer, tot. varighet ca 5,5 timer):

[embedyt] https://www.youtube.com/watch?v=Ho1GEyftpmQ[/embedyt]

Kilder til artikkelen er hentet fra: Scientific Computing, DataCenter Design, Processor datacenter news, Future of Business, Stockholm Business Region Development, ThorDC, Technology At Work, 42U, Virtual Strategy Magazine, Hitachi Data Systems, TIA Online, Energy Star org., DataCenter Knowledge, The Guardian, TeleGeography, m.fl.